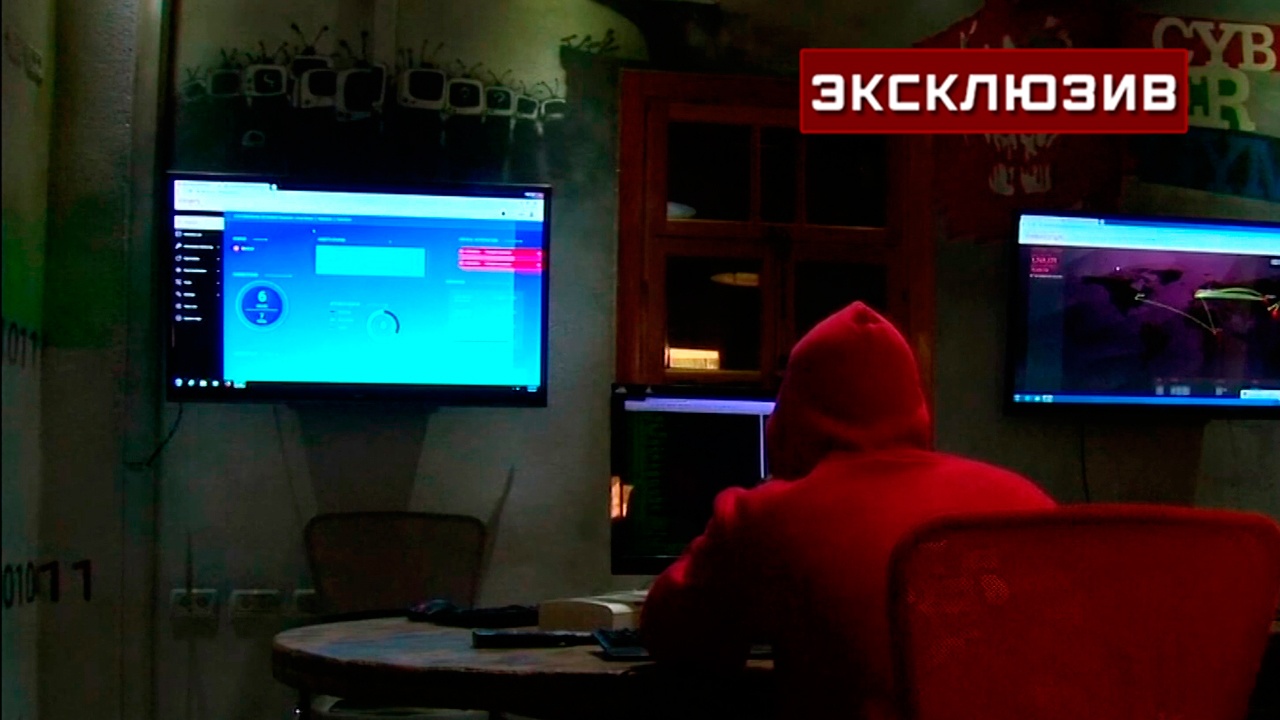

Нейрообман: как технологии превратились в инструмент интернет-мошенников

Человек, не знакомый с такими возможностями нейросетей, запросто примет это за чистую монету. Методика синтеза изображения или голоса, основанная на искусственном интеллекте, называется «дипфейк». При помощи такой технологии можно интегрировать лицо и голос кого угодно и как угодно.

Технология, которая активно используется в кинематографе для «воскрешения» ушедших из жизни актеров или «омолаживания» звезд без использования грима, теперь активно используется отнюдь не в самых благородных целях.

Мошенники, для того чтобы заполучить желанные записи голосов, взламывают аккаунты пользователей, после чего дают нейросети проанализировать все аудиосообщения, чтобы в дальнейшем использовать смоделированный голос для своих корыстных целей.

«Для того чтобы обучить нейросеть разговаривать голосом какого-либо человека, достаточно несколько видео. Или записать голос под предлогом какого-нибудь опроса», - рассказал министр цифрового развития и связи Нижегородской области Александр Синелобов.

Если раньше сценариями а-ля «мама, я попал в передрягу, переведи деньги» или «это сотрудник банка, и нам срочно нужны данные вашей карты» обманывали, как правило, пожилых людей, то теперь мошенники стали выдумывать куда более правдоподобные истории.

Обезопасить себя от взлома поможет двухфакторная аутентификация - дополнительная защита, которая срабатывает при входе в мессенджер, браузер или социальную сеть. После введения пароля надо ввести, например, код, пришедший по СМС или на электронную почту. Также эксперты не рекомендуют проходить по непроверенным ссылкам, скачивать сторонние приложения и подключаться к открытым сетям Wi-Fi.